Google Search Console es la herramienta gratuita de Google que te permite ver exactamente cómo el buscador más usado del mundo rastrea, interpreta y posiciona tu sitio web. Si llevas tiempo escuchando hablar de ella pero nunca has entrado a fondo, o si ya la usas pero sientes que solo rascas la superficie, esta guía es para ti. Aquí encontrarás desde cómo hacer el Google Search Console login y verificar tu propiedad, hasta cómo interpretar el informe de rendimiento, corregir errores de rastreo y adaptar tu estrategia a los nuevos resúmenes de inteligencia artificial que están cambiando las reglas del juego SEO en 2026.

¿Qué es Google Search Console y para qué sirve en el marketing digital?

Muchos la conocen todavía por su nombre anterior: google webmaster tools. Google rebautizó la plataforma en 2018 con una denominación más orientada al negocio y al contenido, pero la esencia no ha cambiado tanto como parece: sigue siendo la ventana oficial entre tu dominio y el algoritmo de Google.

Entonces, ¿Qué es Google Search Console exactamente? Es una infraestructura de diagnóstico y comunicación bidireccional. No mide lo que pasa dentro de tu web después de que el usuario hace clic (eso lo hace Google Analytics), sino lo que ocurre antes: cuántas veces apareces en los resultados, en qué posición, con qué consultas de búsqueda y cuántos usuarios acaban haciendo clic hacia tu página. Esta es su web.

¿Para qué sirve Google Search Console?

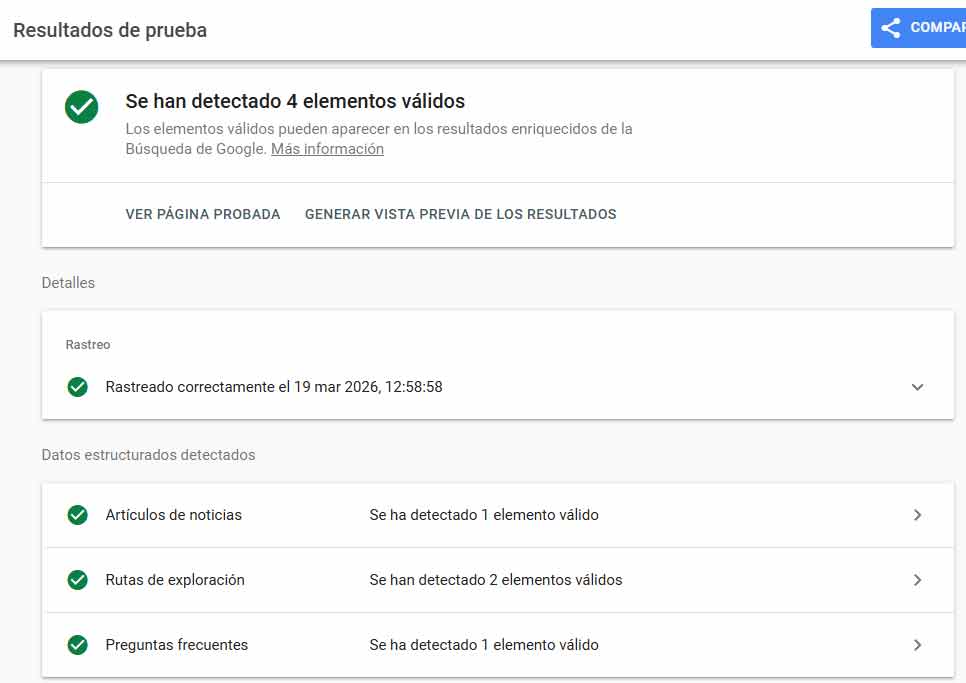

Aquí la lista se vuelve generosa. Te avisa de forma proactiva cuando Googlebot detecta malware, phishing o acciones manuales por incumplimiento de directrices. Valida si tus datos estructurados (recetas, productos, eventos, FAQs) están bien implementados para optar a los resultados enriquecidos. Te muestra qué páginas están indexadas, cuáles tienen errores de rastreo y cuáles el motor ha decidido ignorar. Y en 2026, con las actualizaciones más recientes, también te permite monitorizar tu presencia dentro de los bloques de resúmenes generativos de IA que están copando la parte superior de los resultados.

En pocas palabras: si Google Analytics te dice qué hacen los usuarios en tu web, Google Search Console te dice qué hace Google con tu web.

Evolución desde Webmaster Tools hasta el diagnóstico avanzado

Las google webmaster tools nacieron en 2006 como una consola técnica básica pensada para desarrolladores. Su función principal era identificar enlaces rotos y errores de rastreo. Hoy, diecinueve años después, la plataforma integra diagnósticos de experiencia de página, validación de resultados enriquecidos, análisis de rendimiento por tipo de dispositivo, herramientas de inspección de URL en tiempo real y, en los mercados donde ya está disponible, filtros de análisis impulsados por lenguaje natural. El recorrido desde aquella consola rudimentaria hasta el panel de control predictivo actual refleja hasta qué punto el SEO técnico y el negocio digital han crecido juntos.

Diferencias técnicas fundamentales entre Google Search Console y Google Analytics

Esta es, probablemente, la pregunta que más confusión genera en equipos de marketing. La respuesta corta: no son lo mismo, no miden lo mismo y no deberías elegir entre las dos, sino usarlas juntas.

La diferencia filosófica es clara. Google Search Console opera en la frontera del clic: rastrea impresiones, posiciones y consultas orgánicas en la página de resultados. Google Analytics entra en escena en el segundo posterior al clic, midiendo sesiones, tiempo de permanencia, conversiones y comportamiento de navegación.

Clics frente a sesiones: comprendiendo las discrepancias de atribución

Cuando comparas los clics que reporta Google Search Console con las sesiones orgánicas de Analytics, los números casi nunca coinciden. Esto no es un error; es una consecuencia de cómo cada plataforma mide la realidad.

| Variable | Google Search Console | Google Analytics |

|---|---|---|

| Unidad base | Clic en resultado orgánico | Sesión (bloque de actividad continua) |

| URLs | Consolida bajo URL canónica | Registra cada variación de URL por separado |

| Archivos PDF | Registra clics directos desde la SERP | Requiere configuración de eventos adicional |

| Tráfico de bots | Puede incluir rastreadores ocasionalmente | Filtra tráfico automatizado en tiempo real |

| Retardo de datos | 24-48 horas de procesamiento | Datos casi en tiempo real |

| Límite de exportación | 1.000 consultas por informe de URL | Sin limitación comparable |

Un solo clic en Search Console puede generar varias sesiones en Analytics si el usuario regresa horas después por otra vía. Un clic puede no generar ninguna sesión si el usuario abandona antes de que el script de seguimiento termine de cargarse. Y si tu dominio genera parámetros dinámicos de URL (como ?categoria=precio), Search Console los agrupa bajo la URL canónica mientras Analytics los trata como páginas distintas.

Entender esta asimetría es fundamental para construir embudos de atribución fiables. El especialista que confunde clics con sesiones acaba tomando decisiones basadas en datos mal interpretados.

Proceso exhaustivo de configuración y verificación de propiedades

El acceso a los datos de Search Console no es público. Antes de poder ver resultados de búsqueda de tu dominio, tienes que demostrar que eres su propietario legítimo. Este proceso se llama verificación de propiedad y es el primer paso obligatorio.

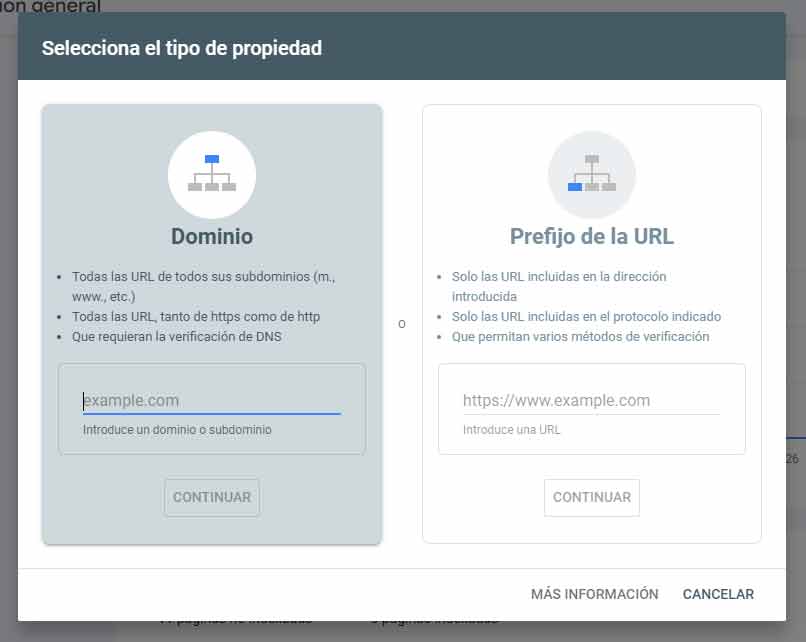

Propiedades de dominio frente a prefijo de URL: implicaciones de rastreo

Tienes dos opciones al añadir una propiedad, y la elección importa más de lo que parece.

La propiedad de dominio es la opción más completa. Al verificar el dominio raíz (por ejemplo, tudominio.com), la plataforma agrupa automáticamente todo lo que hay debajo: versiones HTTP y HTTPS, subdominios como blog.tudominio.com o tienda.tudominio.com, y cualquier subdirectorio. Si quieres una visión global de tu huella digital sin fragmentar datos entre propiedades, esta es la opción correcta. El único requisito es acceso a tu panel de gestión de DNS para insertar un registro TXT que Google te proporcionará. La propagación puede tardar desde unas pocas horas hasta un día completo.

La propiedad de prefijo de URL es más granular y estrictamente literal. Si verificas https://www.tudominio.com/es/, la plataforma no verá nada de lo que ocurre fuera de esa ruta exacta. Esto tiene usos legítimos y poderosos: permite a empresas con operaciones en varios países dar acceso segmentado a equipos regionales sin exponer métricas globales, o auditar campañas específicas con precisión quirúrgica.

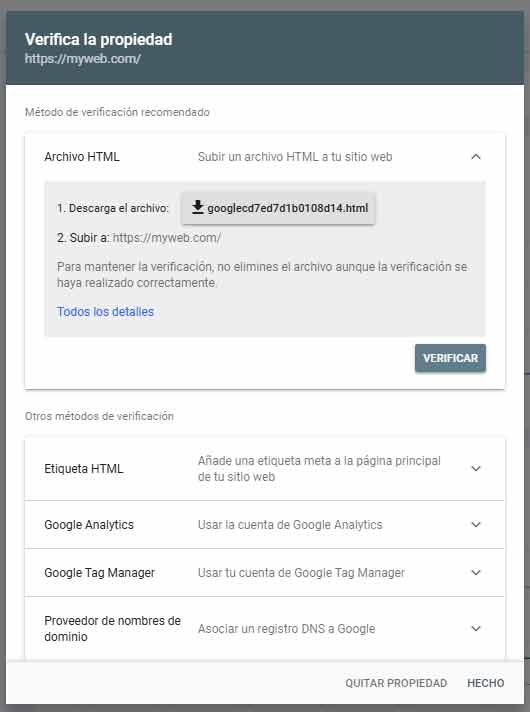

Protocolos de verificación y delegación de permisos

Para la propiedad de prefijo de URL tienes varias vías de verificación. La más resiliente es cargar un archivo HTML criptográfico en la raíz del servidor. También puedes insertar una metaetiqueta <meta> en el <head> de tu página principal, o delegar la confianza a través de cuentas de Google Analytics o Google Tag Manager previamente verificadas, una opción muy práctica para equipos sin acceso directo al servidor.

Una advertencia que muchos equipos aprenden a las malas: los rastreadores de Google verifican periódicamente que los tokens de autenticación siguen en su sitio. Si una actualización de plantilla borra la metaetiqueta o una migración de servidor elimina el archivo HTML de verificación, pierdes el acceso a la propiedad pasado el periodo de gracia.

En cuanto a la gobernanza de usuarios, la plataforma distingue entre propietarios verificados (derechos absolutos), propietarios delegados y usuarios con permisos completos o de solo lectura. Configurar correctamente esta matriz es una práctica básica de seguridad operativa que muchos equipos pasan por alto.

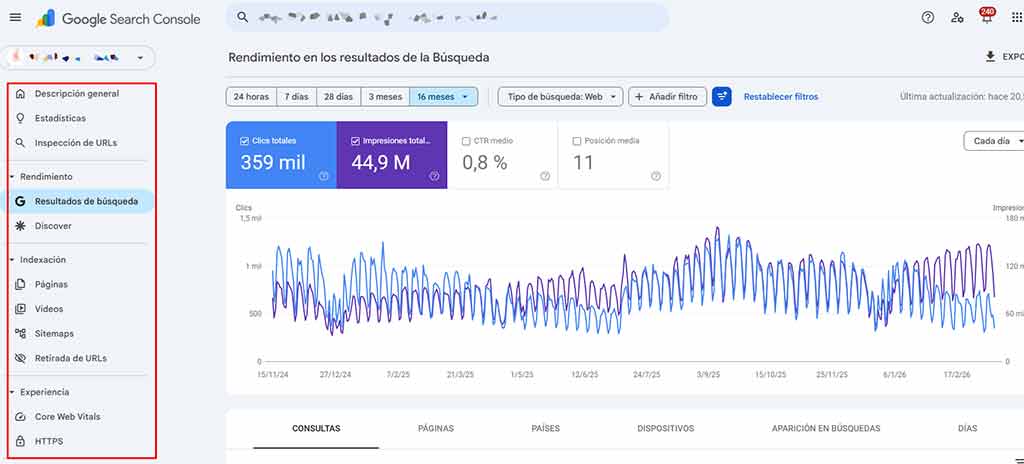

Dominando el informe de rendimiento y la monitorización de tráfico

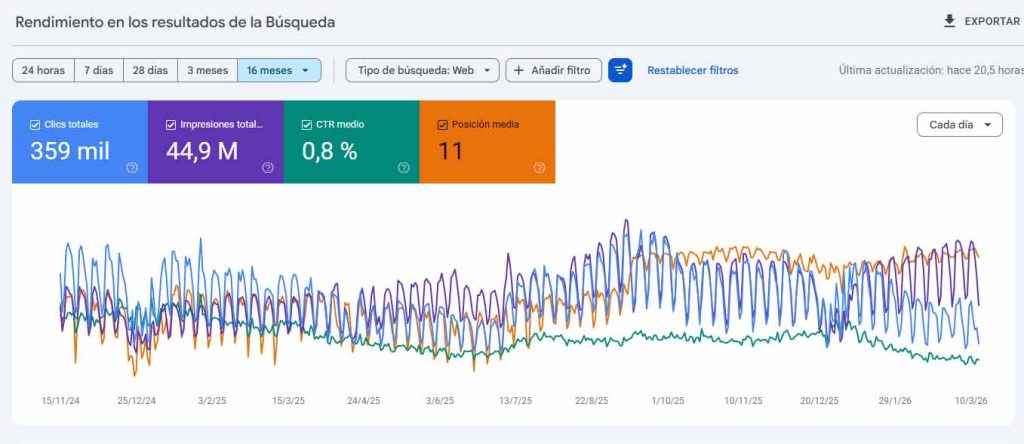

El informe de rendimiento es el corazón de la plataforma. Es donde aprendes cómo usar Google Search Console de verdad, más allá de las capturas de pantalla de tutorial. Las cuatro métricas cardinales son impresiones, clics, CTR y posición media, pero interpretarlas bien requiere contexto.

Impresiones, clics, CTR y la nueva matemática de la posición media

- Una impresión se registra cada vez que tu enlace aparece en los resultados orgánicos, aunque el usuario no haga scroll hasta verlo. Una impresión alta con pocos clics es un diagnóstico claro: o estás clasificando en la segunda o tercera página donde nadie llega, o tu título y meta descripción no consiguen captar la atención de quien sí te ve.

- La tasa de clics (CTR) es el indicador más honesto del rendimiento de un resultado. Divide los clics entre las impresiones y multiplica por cien. Un CTR bajo en posiciones del top 5 es una señal de que el fragmento que muestra Google no conecta con la intención de búsqueda real.

- La posición media es donde más cuidado hay que tener en 2026. Históricamente, posición 1 significaba el mayor tráfico posible. Hoy, esa posición número 1 puede aparecer visualmente debajo de un bloque generativo de resúmenes de IA, un módulo de compras y un paquete de resultados locales. El enlace azul sigue estando en primera posición técnicamente, pero su visibilidad real y su CTR son una fracción de lo que eran hace tres años. Cruzar los datos de posición con el desglose por dispositivo (móvil frente a escritorio) y por tipo de apariencia en búsqueda (

Search Appearance) es obligatorio para interpretar el rendimiento con precisión.

Auditoría técnica: optimización de indexación, sitemaps y presupuesto de rastreo

Para que Google pueda posicionar tu contenido, primero tiene que encontrarlo, renderizarlo y archivarlo. La sección de sitemaps y el informe de indexación de páginas son las herramientas que te permiten garantizar que ese proceso ocurre sin fricciones.

Anatomía de los sitemaps XML y diagnóstico de páginas huérfanas

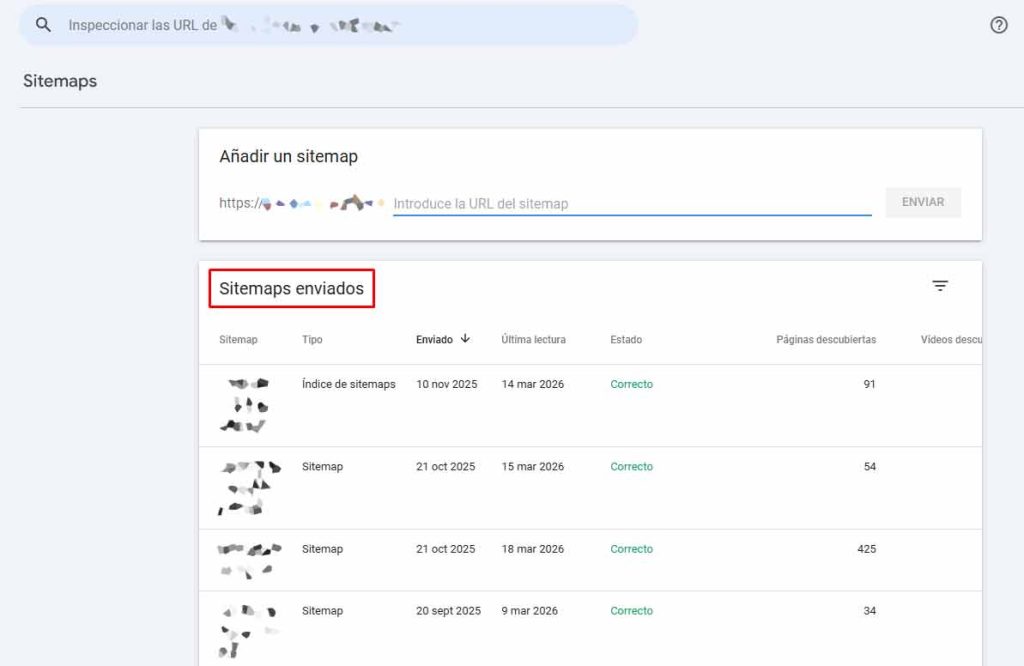

Un sitemap XML no es un truco de posicionamiento; es un mapa cartográfico oficial de tu dominio. Su función es acelerar el descubrimiento de URLs y gestionar el crawl budget (el presupuesto de rastreo): la cantidad finita de recursos que Googlebot dedica a tu sitio en cada visita.

En sitios de comercio electrónico con miles de referencias de producto, o en medios de comunicación con decenas de publicaciones diarias, enviar un sitemap depurado desde la pestaña correspondiente en Search Console es crítico. La plataforma te muestra de inmediato cuántas URLs han sido procesadas correctamente y cuántas han sido ignoradas por bloqueos en el robots.txt o por etiquetas de exclusión.

Antes de enviar el sitemap, vale la pena auditarlo con herramientas como Semrush Site Audit para purgar páginas huérfanas, duplicadas o de escaso valor semántico. Enviar URLs problemáticas no penaliza directamente, pero dilapida el presupuesto de rastreo en contenido que no aporta.

El informe de indexación de páginas (antiguo informe de cobertura) clasifica tus URLs en cuatro estados: válidas, válidas con advertencias, excluidas y con error. Un volumen alto de páginas excluidas no es necesariamente una mala señal: puede reflejar el uso correcto de directivas canónicas, redirecciones estratégicas o metaetiquetas noindex aplicadas a páginas de poca relevancia semántica como políticas de cookies, resultados de búsqueda interna o carritos vacíos.

Resolución de errores: 404, soft 404, 5xx y bucles de redirección 3xx

Los errores son donde muchos sitios pierden autoridad sin darse cuenta. Aquí tienes los más críticos y cómo actuar ante cada uno:

- Errores de servidor 5xx. Googlebot llega al dominio pero el servidor no puede procesar la solicitud. Causas habituales: agotamiento de memoria, base de datos caída o servidor en mantenimiento colapsado. Requiere intervención inmediata a nivel de hosting: revisar logs de PHP/Apache/Nginx, escalar recursos o purgar cachés. Una vez resuelto, usa el botón «Validar corrección» en Search Console.

- Error 404. La URL solicitada no existe en el servidor. Un 404 estático no penaliza globalmente, pero consume presupuesto de rastreo y rompe la experiencia si hay enlaces internos apuntando a ese vacío. Si la página eliminada acumulaba autoridad de enlace, implementa una redirección 301 hacia la página activa más relevante para preservar el PageRank transferido.

- El soft 404 es la anomalía más peligrosa porque es silenciosa. La página se renderiza mostrando un mensaje de «producto agotado» o «página no encontrada», pero el servidor devuelve un código HTTP 200 (éxito) al rastreador. El resultado: Google indexa una página vacía de valor. La solución pasa por configurar el CMS para que devuelva un encabezado HTTP 404 o 410 real en esas rutas.

- Errores de redirección 3xx. Aparecen cuando hay bucles infinitos (URL A redirige a B, B redirige a A) o cadenas de múltiples saltos que el robot abandona por política de eficiencia. Audita los archivos

.htaccesso las reglas de Cloudflare y consolida cada redirección para que cualquier URL obsoleta llegue al destino final en un único salto 301.

La herramienta de inspección de URL te permite ejecutar un «Test Live URL» que solicita a Google que descargue, ejecute el JavaScript y renderice la página tal como la vería el motor. Es el diagnóstico definitivo antes de hacer cambios estructurales importantes.

Core Web Vitals y el informe de experiencia de página

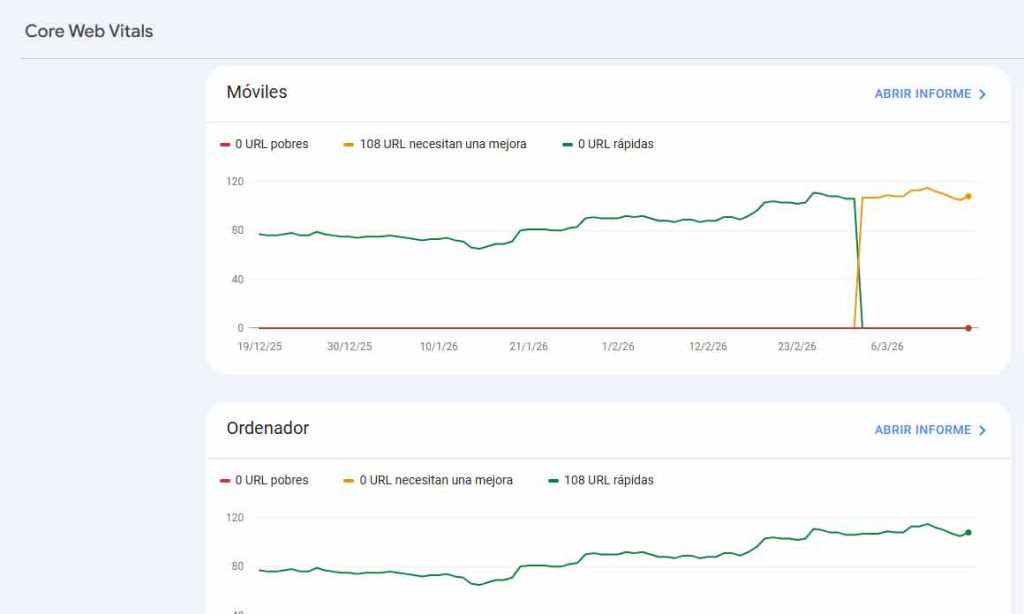

Los algoritmos de clasificación de Google llevan años incorporando la experiencia técnica del usuario como factor de posicionamiento. El informe de experiencia de página en Search Console cuantifica esa experiencia a través de las métricas conocidas como Core Web Vitals.

Optimización de LCP y CLS para superar los umbrales de Google

El LCP (Largest Contentful Paint) mide el tiempo que tarda en renderizarse el elemento visual más grande de la parte visible de la pantalla sin hacer scroll: habitualmente una imagen destacada, un vídeo o el bloque del titular H1. Para estar en el estado «Rápida» y obtener el impulso algorítmico asociado, el LCP debe completarse en 2,5 segundos o menos. Por encima de 4 segundos, la URL cae en la categoría «Lenta» y se generan alertas rojas en la plataforma.

Las palancas técnicas para mejorar el LCP incluyen preconexión de servidores externos (preconnect), precarga de activos críticos (preload), compresión de imágenes hacia formatos modernos como WebP o AVIF, y retraso en la ejecución de scripts de terceros que bloquean el hilo principal del navegador.

El CLS (Cumulative Layout Shift) cuantifica los desplazamientos visuales inesperados del diseño: ese momento frustrante en que estás a punto de pulsar un botón y el contenido se desplaza porque ha aparecido un banner o una imagen que carga tarde. Un puntaje CLS óptimo es 0,1 o inferior. Las causas habituales son banners publicitarios sin dimensiones predefinidas, imágenes con carga diferida sin marcadores de posición espaciales y sustituciones tardías de fuentes tipográficas. Corregir los fallos que expone este informe tiene una correlación estadística directa con descensos en tasas de rebote y mejoras en conversiones.

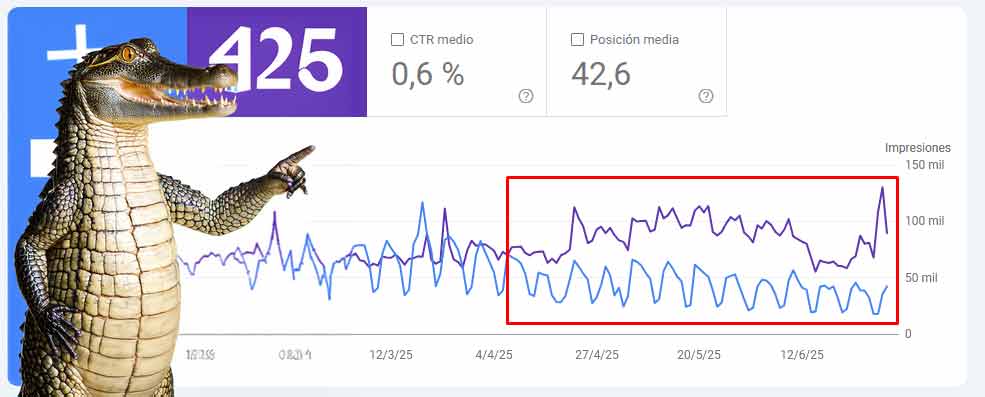

El paradigma de 2026: Google Search Console y la revolución de la IA

Este es el capítulo que convierte esta guía en algo distinto a un tutorial genérico. El ecosistema de búsqueda de 2026 no se parece al de 2022. Los motores de síntesis impulsados por grandes modelos de lenguaje como Gemini han alterado de forma radical las reglas de visibilidad orgánica.

El objetivo ya no es exclusivamente monopolizar el primer enlace azul tradicional. El nuevo objetivo es forjarse una reputación computacional como fuente de autoridad verificada, de modo que los modelos de IA seleccionen tu dominio, lo resuman y lo citen dentro de los bloques de resúmenes de IA (AI Overviews) que coronan más de la mitad de las búsquedas en los mercados más competitivos. Este proceso se conoce como GEO: Optimización para Motores Generativos, que nuevamente ME NIEGO A ACEPTAR

Monitorización de resúmenes de IA y el modo IA

La irrupción del bloque generativo en la parte superior de los resultados ha provocado caídas documentadas del CTR orgánico hacia páginas tradicionales de hasta un 61%. El contenido informacional superficial y genérico que la IA puede sintetizar en milisegundos ha perdido su razón de existir como destino de clic y hacer que la gráfica de efecto cocodrilo (maldita sea) aparezca en Search Console. Si entrecierras lo ojos y miras al cuadro rojo lo verás 😉

La cara contraria de esa moneda es la oportunidad asimétrica. Cuando un dominio consigue que sus URLs sean citadas explícitamente dentro del bloque de resúmenes de IA, experimenta un incremento promedio del 35% en clics directos, y los visitantes que llegan por esa vía muestran tasas de conversión del 14,2%, frente al 2,8% del tráfico orgánico tradicional. El usuario que llega desde una cita de IA llega habiendo heredado la validación de autoridad que el propio agente generativo le ha transferido.

Google Search Console está implementando integraciones experimentales para medir esta nueva realidad. En mercados de prueba seleccionados, la plataforma ha introducido filtros bajo la nomenclatura «Modo IA» que permiten discernir qué porcentaje de impresiones y clics provienen del interior del bloque generativo o de sugerencias conversacionales en la barra de Chrome.

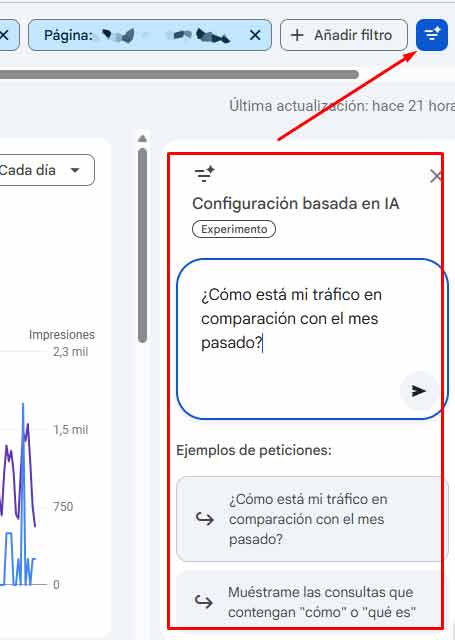

Filtros de configuración impulsados por lenguaje natural

Una de las novedades más llamativas de Search Console en 2026 es la «Configuración impulsada por IA». En lugar de anidar filtros manualmente o usar expresiones regulares (Regex), puedes formular consultas analíticas en lenguaje natural puro. Por ejemplo: «Muestra el CTR promedio y la posición de las consultas que contienen la palabra ‘deportes’, restringido a búsquedas en móvil en España durante los últimos 28 días». El modelo interno interpreta la solicitud y aplica todos los cruces de variables al instante. Por ahora está limitado a las métricas fundamentales de búsqueda (clics, impresiones, CTR, posición) y excluye propiedades de Discover o News, pero reduce horas de minería de datos a segundos.

La estrategia para prevalecer ante los algoritmos de síntesis pasa por la densidad de datos inescrutables: investigaciones primarias, tablas comparativas con datos propios, metodologías respaldadas por evidencia, autoría real y demostrable, y una red de citaciones contextuales sólida. Los modelos de IA priorizan fuentes que ofrecen información que no pueden fabricar por sí mismos.

Un dato relevante: portavoces oficiales de Google han descartado la utilidad del archivo llms.txt para guiar rastreadores de IA, reafirmando que los sitemaps XML y los marcadores semánticos estándar siguen siendo la arquitectura técnica de referencia. Si, por el contrario, quieres excluir tu contenido de los resúmenes generativos, puedes aplicar metaetiquetas como <meta name="googlebot" content="nosnippet"> o el atributo data-nosnippet para proteger secciones específicas.

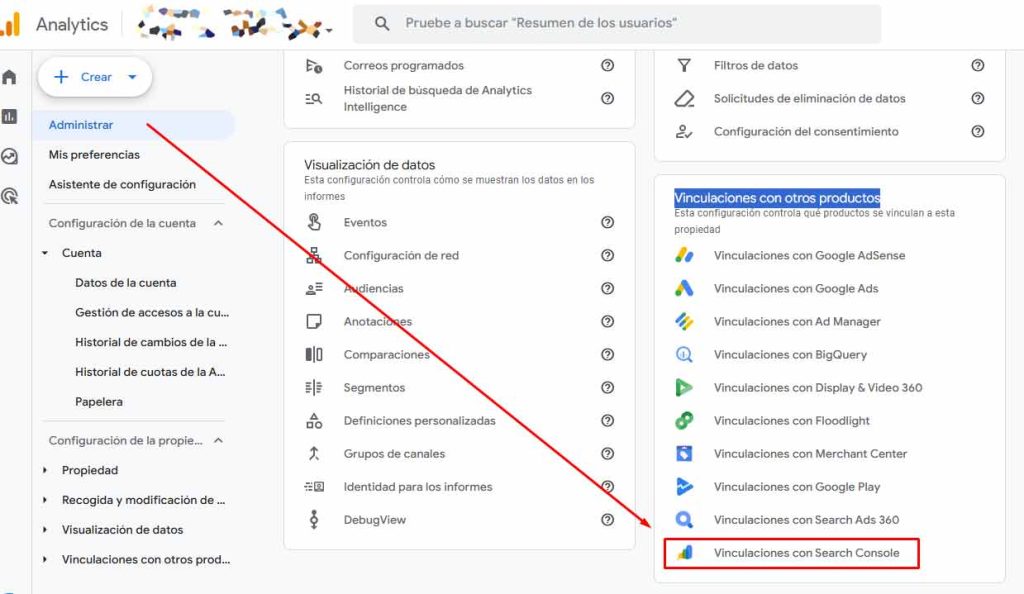

Cómo conectar Google Search Console a Google Analytics

Cómo conectar Google Search Console a Google Analytics es una de las consultas más frecuentes entre quienes empiezan a trabajar con ambas plataformas, y la buena noticia es que el proceso es sencillo y el resultado es muy valioso.

La integración permite ver los datos de Search Console directamente dentro de los informes de Google Analytics 4, cruzando métricas de rendimiento orgánico con el comportamiento post-clic en una misma interfaz.

- Para hacerlo, entra en Google Analytics 4 con una cuenta que tenga permisos de administrador. Ve a Administrador → Vinculaciones con otros productos → Search Console. Pulsa en «Vincular» y selecciona la propiedad de Search Console correspondiente a tu dominio. Acepta y guarda.

- Una vez activa la vinculación, los datos tardan hasta 24 horas en aparecer. Dentro de GA4 encontrarás los informes integrados en la sección de Adquisición → Adquisición de tráfico, con un desglose específico de la búsqueda orgánica que incluye consultas, clics, impresiones y CTR directamente desde GSC.

Esta conexión es especialmente útil para identificar qué consultas atraen tráfico orgánico y qué hace ese tráfico una vez dentro del sitio: si convierte, qué páginas visita, cuánto tiempo permanece. Es el puente entre la intención pre-clic y el comportamiento post-clic que convierte dos herramientas complementarias en un sistema de análisis completo.

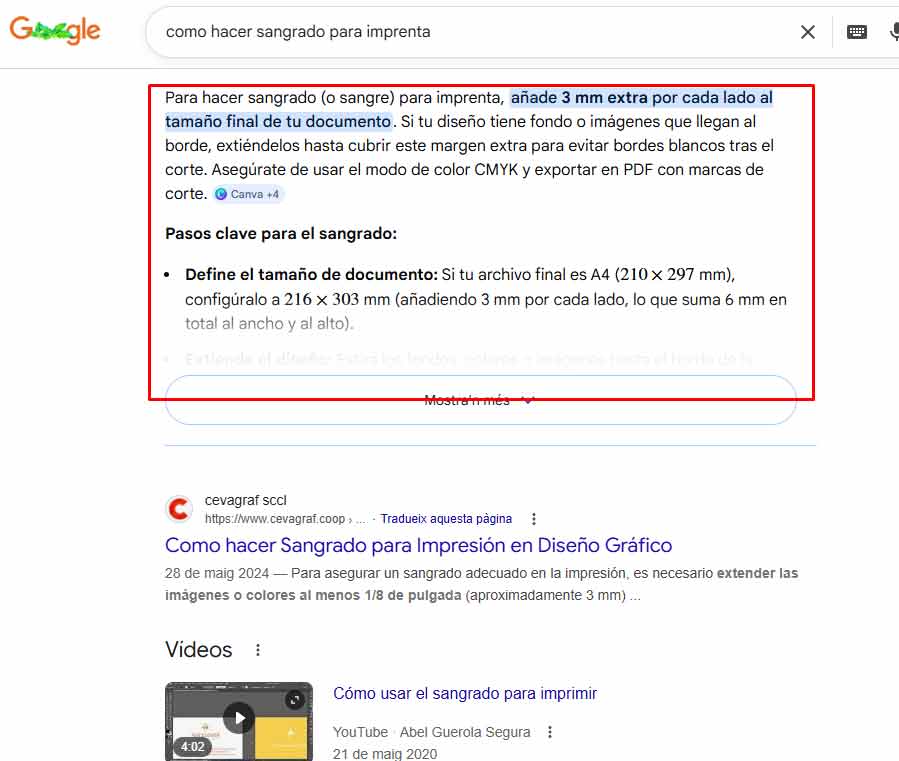

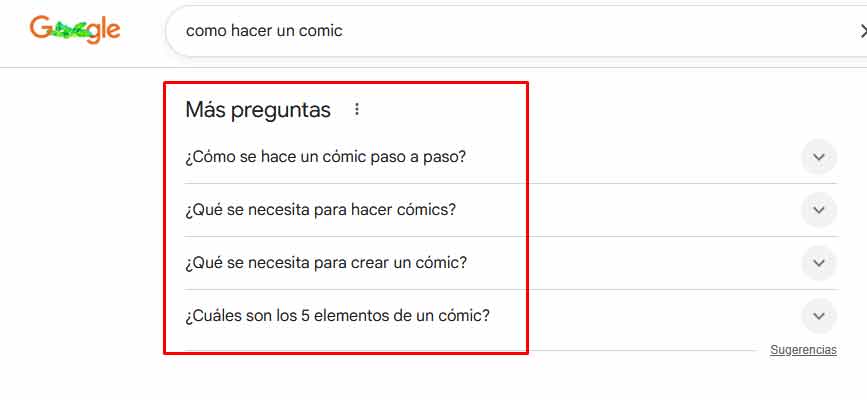

Tácticas avanzadas: conquistando las preguntas de los usuarios (PAA)

El módulo «Otras preguntas de los usuarios» (PAA, People Also Ask) aparece ya en la mayoría de búsquedas informacionales y representa una superficie de visibilidad enorme que muchos equipos infravaloran. Las estadísticas de interacción directa son modestas (la tasa de despliegue de un acordeón PAA ronda el 3% de observadores, y el clic saliente puede caer por debajo del 0,3% en búsquedas masivas), pero el error es interpretarlas de forma aislada.

Aparecer de forma sistemática en cientos o miles de bloques PAA relacionados con tu temática genera impresiones masivas que actúan como catalizador del reconocimiento de marca. Y consolidar esa presencia refuerza la autoridad temática que el motor percibe del dominio, lo que eleva su rendimiento en los términos de mayor valor transaccional.

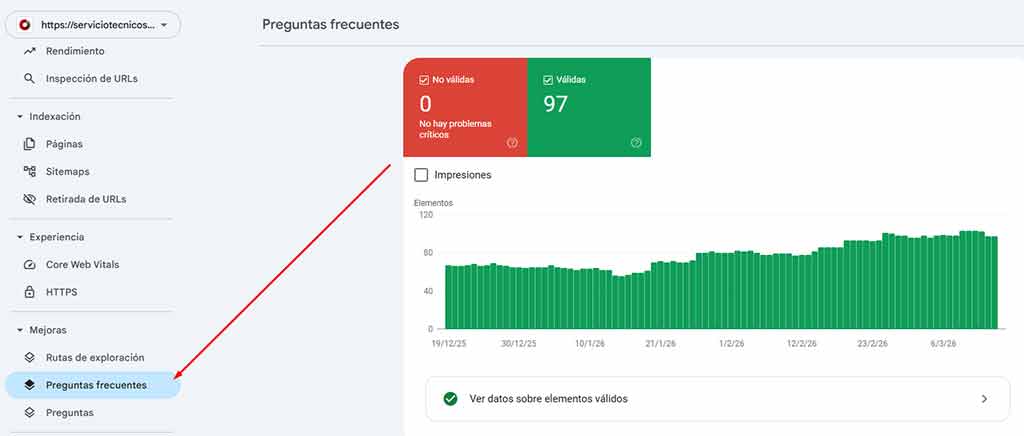

Implementación de datos estructurados para optimizar el CTR

La palanca técnica para entrar en los bloques PAA con consistencia es el FAQPage Schema implementado en JSON-LD. Al estructurar una pregunta y su respuesta dentro de un bloque de script en el DOM, el rastreador no tiene que inferir qué párrafo responde a qué intención: la información llega en un formato perfectamente legible para el modelo, preparada para ser extraída y mostrada en los paneles informativos enriquecidos.

Las propiedades obligatorias son la pregunta anidada (Question) con su correspondiente respuesta (acceptedAnswer). Las respuestas deben funcionar como definiciones casi académicas: directas, sin rodeos, que resuelvan la intención en las primeras dos o tres frases.

La investigación de palabras clave para alimentar esta estrategia debe filtrar específicamente términos formulados como preguntas: quién, cómo, cuándo, por qué, cuánto. Exporta los paneles PAA de tus competidores principales para identificar las preguntas que ya están generando visibilidad en tu sector y construye respuestas más completas y mejor estructuradas que las fuentes actuales, también puedes comprobar si tu página puede generar resultados enriquecidos con esta herramienta de Google.

En 2026, los bloques PAA también están recibiendo inyecciones de resúmenes generativos de IA en pruebas beta extendidas, combinando la síntesis de modelos de lenguaje con enlaces de atribución a sitios. El argumento se cierra solo: una arquitectura técnica densa, con JSON-LD limpio y respuestas directas sin adornos, es la metodología que permite a un dominio sobrevivir a las iteraciones algorítmicas independientemente de cómo Google decida presentar visualmente los resultados.

Para seguir avanzando

Dominar Google Search Console no es un destino, es un proceso continuo. El panorama de 2026 exige que los equipos de marketing y SEO operen simultáneamente en dos velocidades: la de la auditoría técnica rigurosa (errores de rastreo, Core Web Vitals, sitemaps depurados) y la de la adaptación estratégica a los modelos generativos que están redibujando la SERP.

La clarificación de las discrepancias frente a Analytics refina los embudos de atribución. El control granular sobre la indexación garantiza que el presupuesto de rastreo se invierta en las páginas que importan. La optimización de las métricas vitales de rendimiento web mejora la retención y las conversiones. Y la alfabetización profunda en GEO y en los nuevos informes de IA de Search Console coloca a los estrategas en una posición de ventaja real frente a quienes siguen optimizando exclusivamente para el enlace azul tradicional.

El contenido que sobrevive a las purgas algorítmicas de 2026 no es el que más palabras tiene. Es el que más respuestas definitivas ofrece, con la arquitectura técnica que permite a los motores (humanos y artificiales) encontrarlo, comprenderlo y citarlo.